第6期 · 字节财经支付二面

字节 财经支付 二面 4.1 18:00-19:00

项目

打开项目页面展示,不断追问具体实现

- 斑块怎么处理的

Geoserver - 有没有对图像做优化 降分辨率

八股

八股:

GET / POST 的区别

GET:用于从服务器获取资源。比如浏览网页、下载图片、查询数据等。GET 请求通常只读取数据,不会改变服务器的状态(幂等、安全)。参数一般附在 URL 后面,有长度限制,不适宜传递敏感信息。

POST:用于向服务器提交数据,比如提交表单、上传文件、发表评论等。POST 请求不一定是更新已有资源,它更常见的语义是创建新资源或触发服务器处理逻辑

| 对比点 | GET | POST |

| 用途 | 获取数据 | 提交数据 |

| 参数位置 | URL | 请求体 |

| 是否缓存 | 会 | 一般不会 |

| 安全性 | 低 | 相对高 |

| 幂等性 | 幂等 | 非幂等 |

| 长度限制 | 有 | 基本无 |

| 可见性 | 明文 URL | 不可见 |

状态码

2xx,3xx,4xx,5xx状态码 略

大模型

开始大模型考察

Skills 和 MCP 的关系

略

Cursor 好用的点是什么

Cursor 是一款基于 VS Code 重构的 AI IDE,不是单纯的聊天插件,而是把 AI 当成程序员,从代码补全、重构、调试到项目级问答都更自然流畅

| 特性 | 说明 |

| AI 深度集成 | 代码编辑器内直接调用 LLM |

| 上下文理解强 | 能理解整个项目 |

| 自动补全 | 比传统 IDE 更智能 |

| Agent能力 | 可修改多文件 |

| Chat + Code融合 | 边聊边改代码 |

文本的 token 是什么,多模态的 token 是什么

token 是模型处理对象的最小单位(不是单词)

| 类型 | token 表示 |

| 文本 | 字/词 |

| 图片 | patch(图像块) |

| 音频 | 时间片段 |

| 视频 | 帧序列 |

Encoder 和 Decoder 的作用和区别

| 对比 | Encoder | Decoder |

| 作用 | 理解输入 | 生成输出 |

| 输入 | 原始数据 | 编码后的表示 |

| 输出 | 向量表示 | 预测结果 |

| 典型模型 | BERT | GPT |

| 是否生成 | 否 | 是 |

大语言模型怎么实现的

大语言模型本质是:用 Transformer 结构训练一个【预测下一个 token 的概率模型】

数据 → 分词 → 向量化 → Transformer → 训练 → 微调 → 推理

RAG 怎么具体实现

索引构建:

加载与切分

向量化

存储进向量数据库

检索生成:

检索相似文本块

增强提示词

生成

核心步骤:

- 文本切分 (Chunking): 不是简单粗暴地切。好的切分策略会考虑语义完整性,比如按段落、按标题切,并让块与块之间有点小重叠(例如500字一块,重叠50字),防止把一个完整的信息切断。

- 向量化 (Embedding): 选择哪个“嵌入模型”很关键。有通用的(如

OpenAI的text-embedding-3-small),也有专门针对中文优化的(如BAAI/bge-large-zh),选对了能显著提升检索质量。 - 向量数据库: 选哪个库取决于你的场景。本地开发或原型验证可以用轻量级的

Chroma或FAISS;企业级大规模应用则可以考虑Milvus或云端的Pinecone。 - Prompt设计: 这是“生成”环节的灵魂。你需要清晰地告诉模型:“请严格基于以下参考资料回答,如果资料里没有,就说不知道”。这能有效约束模型,让它不乱说。

进阶优化:

- 混合检索: 将“向量搜索”(语义)和“关键词搜索”(如

BM25算法,精确匹配)结合,能同时理解意思和抓住专有名词,效果1+1>2。 - 重排序 (Rerank): 检索出

Top-K个结果后,用一个更精密的模型(如NVIDIANeMo Reranker)对它们重新打分排序,把最相关的信息排在前面,能极大提升最后生成答案的质量。 - 查询改写: 用户的问题可能很口语化或信息不全。用大模型先对原始问题进行润色、扩写,生成几个更清晰、更适合检索的问题再去查资料,召回率会更高。

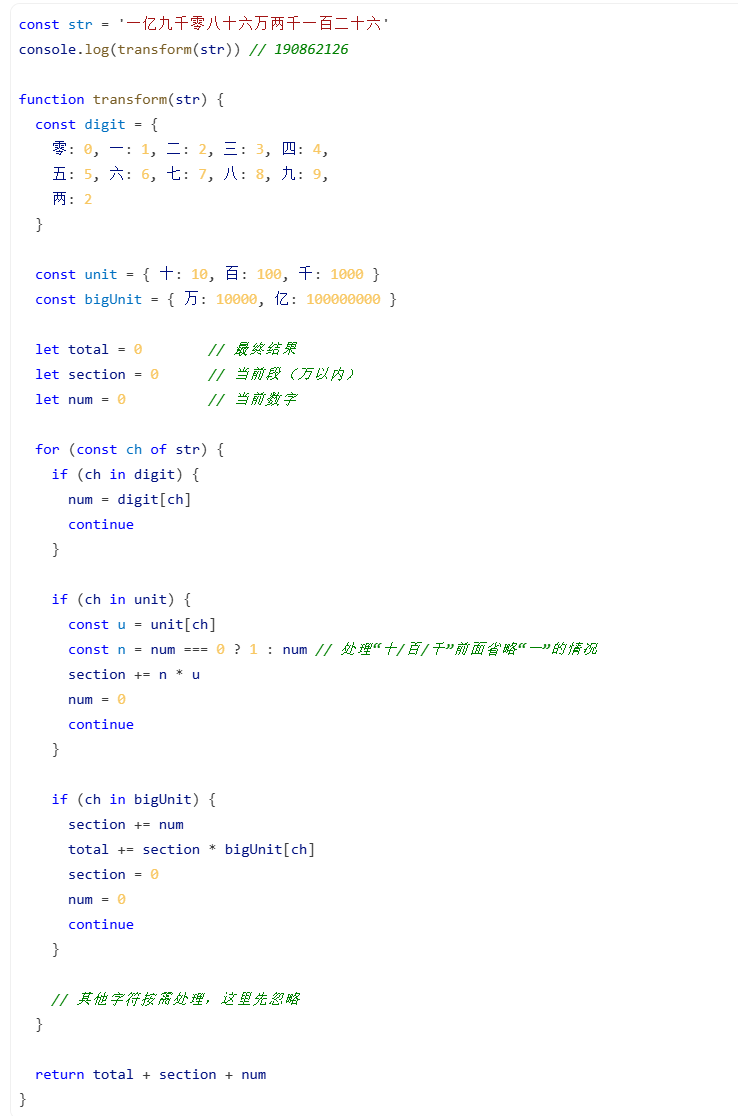

代码题

代码题:字符串转数字

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Fuya0's Blog!